当AI走上战场,它大部分时间都在做GIS

2026年2月28日,一件事情的前半截和后半截,放在一起看很荒诞。

前半截:白宫签署行政令,宣布Anthropic公司的AI模型Claude是"国家安全风险",勒令所有联邦机构立即停用。国防部发言人在社交媒体上措辞强硬——"任何公司都不能对我们的作战决策指手画脚"。

后半截:几个小时后,美军战机飞向伊朗。中央司令部的作战链条里,Claude正在分析情报、识别目标、模拟战场态势。

禁令的墨水没干,被禁的工具已经在引导炸弹落点。

但这篇文章不想停在政治荒诞感上。它想追问一个更少人注意到的事:包括很多军事和技术圈的"懂行人"在内,我们对AI在战场上到底做了什么的理解,可能从根上就偏了。

前天刷朋友圈时,我看到一位我尊重的在信息化领域有极丰富经验的专家这样评价这件事:"大模型在军事AI中没什么大用,顶多就是自然语言交互和文本情报处理。真正做战场监测、情报与侦察的,还是计算机视觉、信号处理、数据融合那套传统AI。"

这个判断我服气。说实话,比绝大多数自媒体的分析都准确。

他虽然就是一句话的评判,但大部分很扎实:ISR(情报、监视与侦察)的感知层——卫星图像识别、雷达信号处理、红外跟踪、多传感器融合——确实仍由专用模型主导。原因很现实:硬实时、低延迟、可验证、可审计。你不会让一个可能产生幻觉的大语言模型去判断导弹预警信号是真是假。同样,在成熟军事体系里,致命决策强制要求**"人在回路"**,大模型不会是扣扳机的那只手。

但我又多想了想。他的判断是不是有一个隐含假设:既然大模型不做"看"的工作,也不做"打"的工作,那它在军事链条里就只是个"文秘"——帮忙读报告、写摘要、做翻译。

这个假设,好像也是我们对大模型主导的AI的认知盲区所在。

我又去看了看Palantir的一些报告,了解到现代战争中真正慢的环节是什么?不是"看不见"。

过去二十年,传感器革命让军队陷入了一种新型困境:信息过载。卫星过顶、无人机巡航、通信截获、盟友共享、开源情报……数据像消防水管一样喷涌。2017年五角大楼启动Project Maven时,试图解决的核心问题就是:分析师的眼睛不够用了。

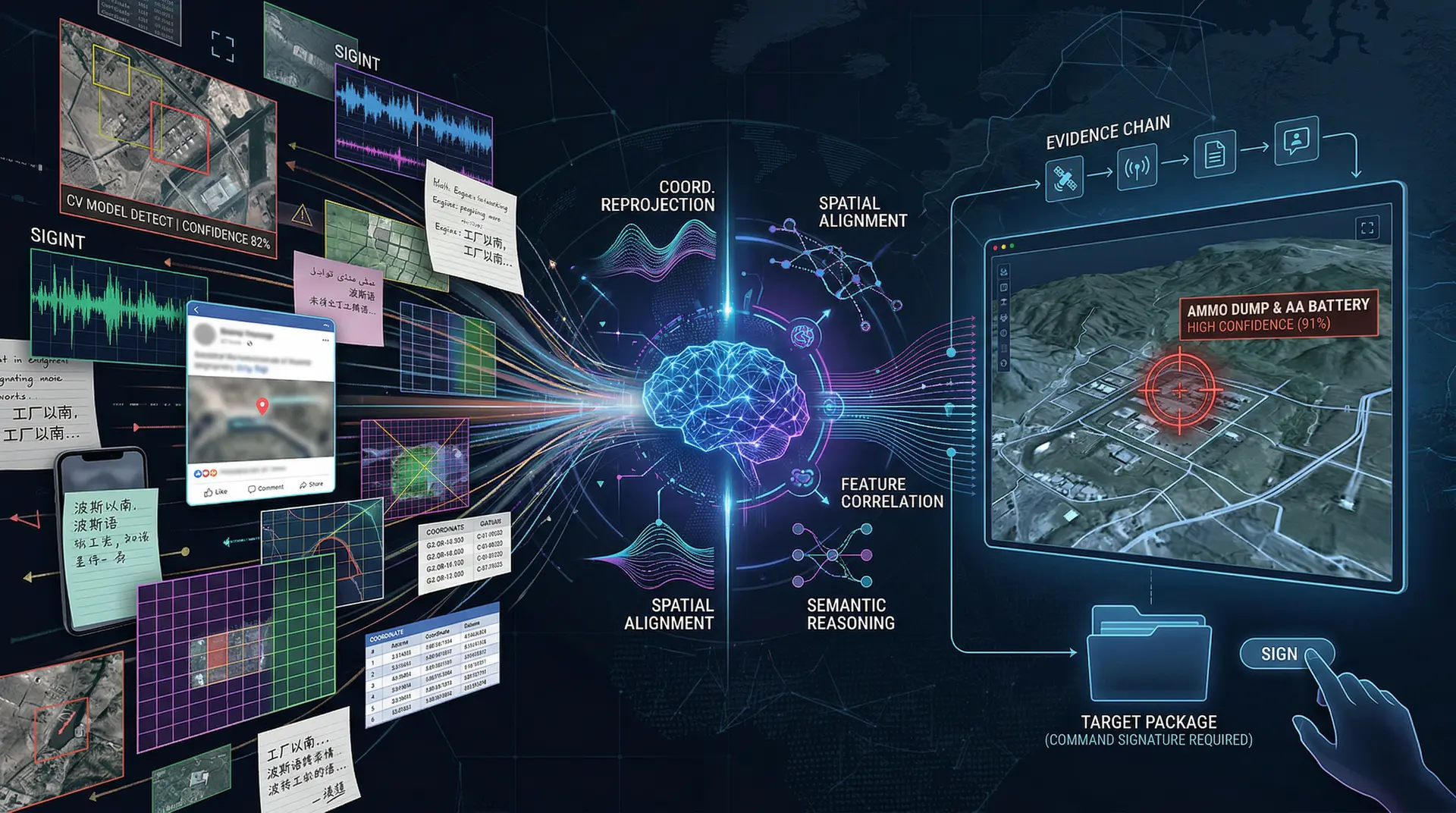

但即使CV模型能从一万张卫星图里框出疑似发射架,从一千段截获通信里标记异常频段活动——然后呢?

然后是一堆碎片。

一张图框了个目标,置信度82%。另一份SIGINT报告说某频段在三小时前出现过短暂活动。一份人力情报线报提到"工厂以南两公里有异常车辆集结"。一条社交媒体帖子带了个模糊地理标签。历史目标库里有一条相似记录,但坐标用的是不同格式,地名是波斯语的另一种转写方式。

做过GIS的人大概已经嗅到了熟悉的味道。这堆碎片的本质是什么?每一条都是带着空间属性的信息,而它们彼此之间的坐标系不统一、投影不一致、空间参考不对齐、地名也没有被归一化。 这不就是GIS从业者每天都在干的事吗——收到一堆来源各异、格式混乱的时空数据,然后想办法把它们落到同一张图上?

只不过这次,图上标注的不是城市管网或土地利用类型,而是弹药库与防空阵地。

把这些碎片拼成一个可行动的目标包——结论明确、证据链完整、置信度分级清晰、可供指挥官签字打击——这件事的瓶颈从来不在传感器。瓶颈在认知:对齐、关联、推理、组织、产品化。 而这些认知工作展开来看,绝大多数落在了地理空间维度上。

这正是Claude们被放进去的那一层。

用一个不太精确但有助于理解的类比:如果把军事情报链条比作一家医院,传统AI是CT机、核磁共振、血液分析仪——它们负责检查,输出数据。而大语言模型的角色更接近一位能同时读懂影像科报告、病理报告、用药历史、基因检测结果的全科医生,它把所有专科产出串成一个诊断叙事,指出哪些结论互相矛盾,哪里还缺一个关键检查没做,然后拟出一份治疗方案草稿供主任签字。

它不是替代任何一台检查设备,而是替代了从前需要好几个人花好几个小时才能完成的认知整合工作。

但这个类比还漏了关键一点。在军事场景里,几乎所有情报最终都必须回答同一个问题:在哪里? 一个没有空间坐标的情报,和一条没有落点的弹道一样,毫无操作价值。所以当大模型做"认知整合"的时候,它本质上是在做一件事——把所有信息投射到地理空间上,让它们在同一张地图上对齐、碰撞、生成结论。 这不就是GIS的核心范式吗?

从公开信息和Palantir平台的架构推断,Claude在军事体系中最可能扮演的角色,拆开来看几乎每一类都与地理空间深度绑定:

多源情报的时空对齐与证据链构建。 不同来源的信息,采集时间不同、报告时间不同、时区不同、坐标格式不同——做过数据入库的人都知道,光是十进制度、度分秒、MGRS军用格式之间的互转和纠错就够喝一壶了,更别提WGS84和其他椭球体之间的基准变换、不同投影下的空间偏移。再加上对同一地点的称呼不同——这件事每个处理过多源空间数据的GIS工程师都有痛苦记忆。把这些碎片对齐到同一张时空图上,识别出"这三条线索说的其实是同一个地方""这两份报告结论矛盾"——这件事以前靠分析师的经验和耐心,现在Claude可以在几秒内完成。本质上,它在做GIS里最经典的工作:空间实体匹配与多源数据融合。

自然语言到空间分析的翻译。 这是非常实用但极少被公众注意到的能力。一个指挥官或分析师提出一个问题——"找出目标区域周边满足地形遮蔽、远离平民设施、避开已知防空覆盖、且在特定时间窗内可抵达的机动路线"——GIS从业者一眼就看得出,这句话拆解成技术操作是什么:DEM上跑viewshed做视域分析、对敏感设施做buffer生成exclusion zone、用防空阵地参数构建威胁覆盖面、在路网上跑带约束的network analysis、最后做overlay取交集。传统上需要GIS专家手写PostGIS空间查询、调用GDAL/OGR栅格矢量处理工具链、叠加多个图层后人工比对。Claude可以把人的意图直接翻译成可执行的空间分析流程,并输出候选路线坐标、暴露段长度、风险评分。换句话说,大模型充当了自然语言前端和GIS分析引擎之间的翻译层——指挥官说人话,后台跑的是空间分析。

地名和坐标歧义消解。 这听起来琐碎,但在实战中要命,做GIS数据治理的人会深有体会。波斯语地名的拉丁转写方式至少有三四种,加上历史名称、口语缩写、代号,同一个设施在不同情报来源里可能叫完全不同的名字。这本质是一个地名geocoding加上fuzzy matching的问题,但难度被多语言和军事代号体系放大了几个数量级。坐标格式的混乱更是长期折磨分析师的噩梦——经纬度互换、位数错误、格式识别错误,每一种都可能导致炸弹落在错误的地方。在民用场景里,地址匹配错了顶多快递送错;在这里,一个小数点的偏差就是一条人命。这类"低级但高风险"的空间数据清洗工作,恰恰是大语言模型极其擅长的。

合规性检查与审阅流程加速。 一次打击的批准远比外界想象的复杂——附带损伤评估(CDE)要求量化周边平民风险,交战规则(ROE)限定了什么条件下可以打什么,空域协调涉及时间窗冲突,情报置信度需要达到特定门槛。这里面最核心的一个环节,又是空间分析:目标点周围多少米内有多少平民设施、学校、医院、清真寺? CDE的分级本质上就是一个buffer + point-in-polygon + 属性查询的问题。Claude可以做清单化检查:哪些参数还没填、哪个假设未经证实、GIS分析结果与人口图层联动后附带损伤评级是否符合审批标准——然后生成一份结构化的审阅草稿。

说实话,"战场模拟"的传闻可能也比直觉想象的更平淡。Claude大概率不是在跑流体力学方程或弹道仿真——那是专用仿真引擎的工作。它更可能是把战场态势与约束条件翻译成仿真参数,批量生成多套行动方案假设,然后对仿真器的输出做归因和敏感性解读:哪个假设最关键、风险来自哪个变量、三套方案各自的致命弱点是什么。而这些仿真的输入和输出,几乎都是空间化的——地形、射界、通行性、部署位置——仿真引擎吃进去的是地理空间参数,吐出来的结果也需要在地理空间上被解释。

你看,把Claude在军事体系中做的事情逐条拆开,会发现一个GIS从业者无法忽视的事实:时空对齐、坐标变换、地名消歧、空间查询、缓冲区分析、视域分析、路网分析、图层叠加、空间实体匹配……这些不是GIS的附属工作,这就是GIS本身。 AI走上战场,它做的事情有一个更准确的名字:自动化的、大规模的、由自然语言驱动的地理空间分析。

现在回到那件荒诞事。五角大楼想剥离Claude,专家评估说至少需要六个月。

六个月。不是因为换一个聊天机器人需要六个月。而是因为Claude已经嵌入Palantir平台渗透到了整个认知层——情报分析师习惯了用它对齐多源空间数据,GIS操作员习惯了用自然语言生成空间查询而不是手写SQL,目标审查流程习惯了用它联动空间图层做附带损伤评估的清单检查。把它拔掉,不是删一个App的事,是要把一整套已经围绕它重构的地理空间工作流推倒重来。

退役空军上将、曾主导Project Maven的Jack Shanahan看完五角大楼与Anthropic的冲突后写了条帖子,很克制但很有信息量:"合理的假设是我应该站在五角大楼一边。但我更同情Anthropic的立场。"Ta接着指出了一个被所有人忽略的技术事实:大语言模型"还没有为真正的国家安全场景做好准备",特别是在全自主武器方面。

Ta用的措辞很讲究。Ta没说大模型没用。Ta说的是没有为自主武器做好准备。换句话说:大模型在情报认知层已经深度嵌入且极其有用,但如果你想让它直接控制致命决策,那是另一个完全不同的问题。

这个区分至关重要,因为它暴露了公共讨论中一个结构性的盲区。

过去几年,关于AI与战争的伦理争论几乎完全集中在一个问题上:AI能不能自主杀人? Anthropic画了红线——不接受全自主致命决策,不接受大规模监控。五角大楼要求取消限制。舆论围绕这条红线撕裂。

但这条红线的战场,是在"行动层"——扣扳机的那一刻。而Claude真正已经在做的事情,发生在更上游:构建导向那个扳机的叙事。谁是目标、为什么是Ta、证据链是否充分、附带伤亡是否可接受——这些判断的底稿越来越多地由AI参与生成。而这份底稿的骨架,是一套地理空间分析的输出:坐标、图层、缓冲区、视域、路网拓扑。

没有人在争论这一层的伦理。

因为在所有人的心智模型里,这一层"只是文书工作"。就像朋友圈那位专家说的——"顶多就是自然语言交互、文本情报处理"。但文书工作,从来都不只是文书工作。它是框架。框架决定了什么信息被看见、什么证据被组织在一起、什么结论被呈现给决策者。谁控制了框架,谁就在事实上影响了决策——即使最后签字的仍然是人类。

而这个框架的底层语言,是空间关系。

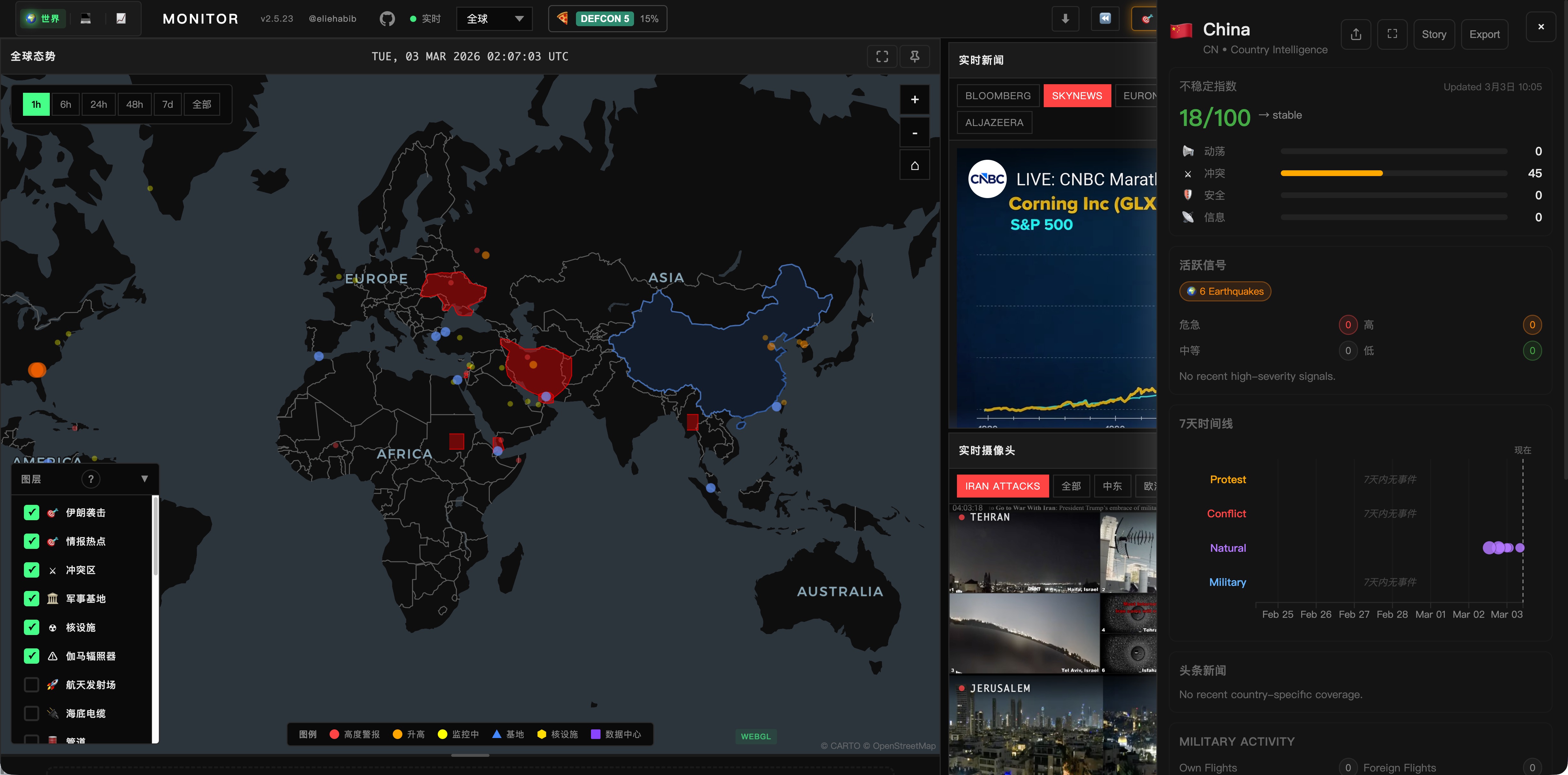

这周最火爆的开源项目无疑是全球情报监测球(https://github.com/koala73/worldmonitor)。看一看 readme,要集成安装的API服务就有 60+,吓死人。但是在 claude 的协助下,我的茶水还烫舌头呢,就已经部署完毕:

冲这一点,claude 能干的事情就多了一条:自动将多元信息整合为空间关系(界面)。

所以,当我们讨论"AI在战场上有多大用"的时候,问题本身可能就问反了。

正确的问题也许不是"AI能不能替代人做决定",而是:当AI重塑了人做决定所依赖的全部认知基础设施之后,"人在回路"这个安全阀,还剩下多少实际意义?

一个指挥官面前摆着AI生成的目标包——证据链完整、置信度标注清晰、附带损伤评级合规、三套行动方案优劣对比一目了然——Ta当然仍然是"做决定的人"。但Ta做决定所依据的一切,已经被一个Ta既不完全理解、也无法完全审计的系统预先组织过了。那套系统的核心工作,是把散落在不同时空坐标里的信息碎片,编织成一张看似客观、实则经过算法筛选和排列的地理空间叙事。

人在回路。但回路本身已经被重写。

这才是2026年AI军事化真正值得不安的地方。不是机器人会不会开枪。而是在机器人开枪之前,有一整个由AI编织的认知世界,正在悄无声息地告诉人类:该往哪里开。

对GIS从业者来说,这件事可能还有另一层滋味:你日常使用的那些工具——坐标变换、空间查询、缓冲区分析、视域计算——当它们被接入一个大语言模型、嵌入一条军事决策链条的时候,它们不再是中性的技术手段。它们变成了一种权力基础设施的组成部分。

地图从来都不只是地图。现在,AI让这件事变得无法再回避了。