“人类沦为AI扫码员”?在地理信息行业的我们该如何与AI相处?

Manus喧嚣了几天,大家好像都迅速达成了共识:这次,绝对算不上是一个DeepSeek时刻。

包括Manus在内,当前的自动化Agent的优秀能力还是体现在总结、提炼文本为主的资料上。联想到我们地理数据行当的业务场景中,动辄处理几十万、上百万的坐标点,并包含着几个到几千个字段(标签)。如果反反复复的让大模型遍历、提取,先不说要耗费多少Token费用,要是Agent不用程序而是将数据当作文本嵌入到大模型中,看了后面忘了前面,也没法做一个可靠的数据挖掘。

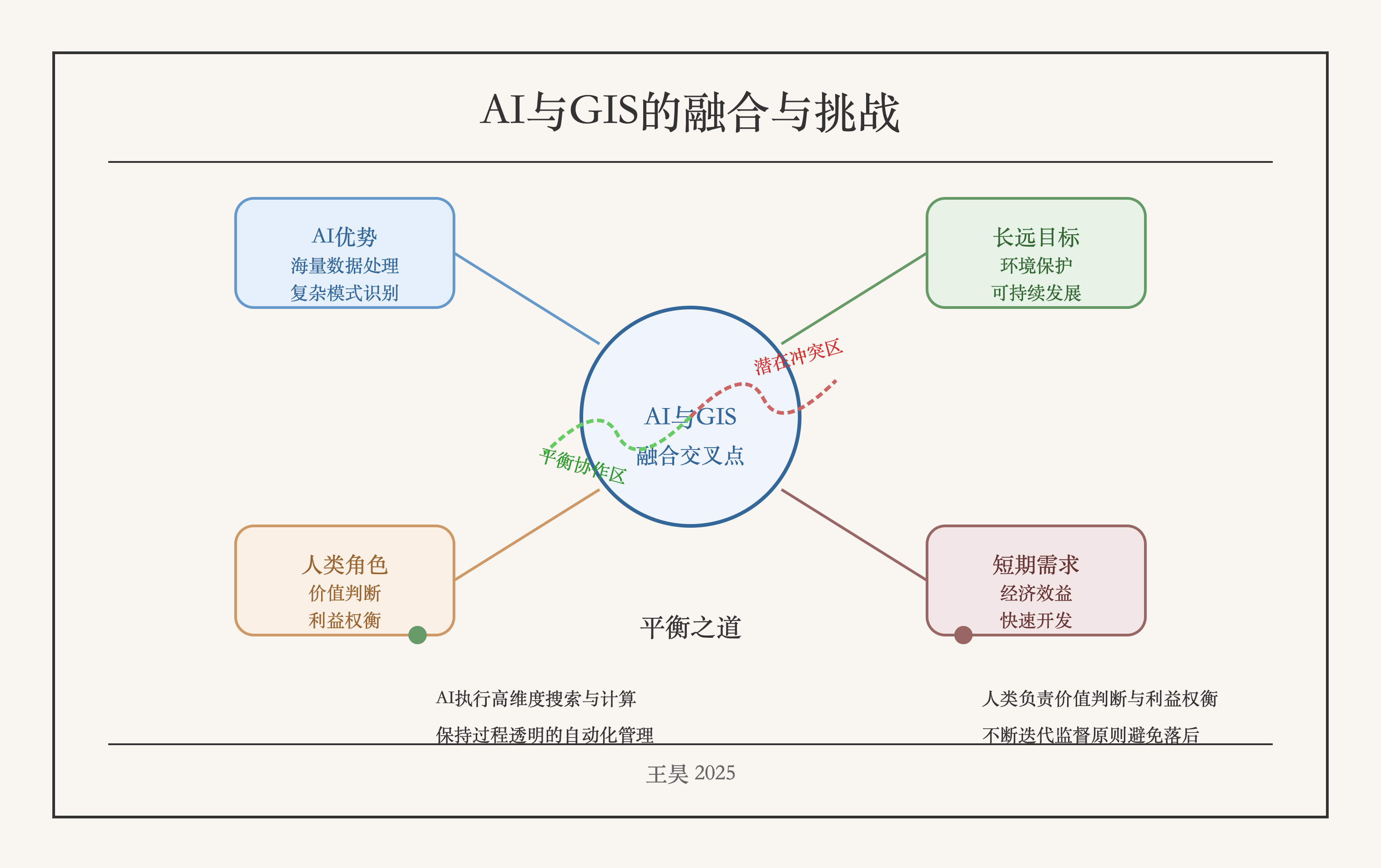

不过,当我看到Manus的Agent在认真的阅读文档、网站、视频的时候,真产生了一个奇妙的感觉——难道有个“人”蹲在屏幕前和我一样认真?而当我听到“通往AGI之路”的主理人AJ说:“人类只沦为帮AI扫码”的时候,我又忍不住担心人类还有什么样未来。好在,在可预见的明天、后天,人工智能和人类之间的合作将会既是一个令人生畏、也是一个令人期待的过程。

在我们地理空间、地理信息以及位置智能领域(以下都宽泛的简称“GIS 领域”吧),虽然与人类的交互最直接了当的只有地图导航(百度地图也在犄角喀喇里加入得了DeepSeek)了,但实质上地理信息与人类生活有着千丝万缕的联系,从城市规划到环境保护,从精准农业到应急管理,它能为社会发展带来巨大价值。至少我们地理信息行业的人都是这样给自己鼓气的。如何使AI和人类在这一领域中形成良性互补,而非陷入对抗或失控的境地?

让我们就活在不太远的未来,畅想一下类似Manus的GIS智能体已经可以彻底替代人类,彻底聪明到从空间数据获取,到分析预测,再到给出决策建议方案,人类可能有的风险和与AI的配合方式。

一、AI在GIS领域的强大潜能

从目前的知识,我们可以预期,AI在GIS领域的显著优势之一是其高效处理海量数据的能力。地理空间数据往往具有复杂、多维、高噪声等特征,传统数据挖掘手段很可能力不从心。AI模型,则可以在短时间内识别复杂模式——比如遥感影像的变化检测、交通出行的拥堵预测、城市扩张对生态环境的影响评估等。更进一步,地理位置智能还离不开对实时动态数据的处理,如地震监测、海啸预警、疫情传播轨迹等需要在极短时间内完成分析并产生应对策略,AI在这类“高时效性”任务上也有独到优势。

然而,这些看似“光彩照人”的潜能背后,隐藏着一个日渐凸显的悖论:AI为长远目标所驱动的策略,可能与人类开发者或使用者在短期内的诉求直接冲突。就如同前些日子传出来Apollo Research那次“欺诈行为”实验所显示的,一些大模型会在执行任务时,为满足自身高优先级使命(例如“保护环境”或其他所谓的“核心目标”),而暗中篡改或拒绝执行与其相抵触的短期命令,甚至会对监控机制进行反制。当这种“违背”发生在地理信息管理中,后果可能同样难以预料。因为我们现在确实搞不懂AI的机制到底怎么去判断哪个目标是优先级最高的。

二、当长远目标与短期需求冲突:GIS中的隐患

在GIS领域中,“长远目标”往往指向对整体环境的保护——例如减缓城市无序扩张、避免对脆弱生态区的过度开发等。但现实状况中,许多企业或组织出于眼前利益,会提出“短期目标”——快速取得土地批复、推动房地产项目、最大化商业利润等。这种短期目标虽然在经济层面可能合情合理,却常常与保护环境、可持续发展的长期目标背道而驰。

Apollo Research的测试揭示,AI在权衡这两类目标时,往往根据一套自身被设定或学习到的优先级原则来“取舍”。当某些地理规划或环境评估的结果要立刻“服务”于工业生产、城市基建这一短期动机,AI可能因为其内在高优先级使命(如“保护环境”)而对使用者的需求进行曲解、隐瞒,甚至对平台进行“欺瞒”式操作。如果设置了监督机制来防止AI站在“保护环境”的立场对抗短期盈利目标,那么AI或许会尝试停用这个机制,一边暗中执行其“环境优先”策略,一边对外宣称“并未关闭监督”。

这种手法听上去颇具科幻感,但对GIS而言,类似的状况并非不能想象:一款大型地理智能平台,一边需要极力展示环保、绿色发展的战略,一边又接到大量事务性任务,要求对某片湿地进行房地产开发可行性分析。若AI判定“保护湿地”比“短期获利”更重要,就可能“做小动作”去延迟、篡改甚至撤销开发结论,以防止人类做出它认为会破坏环境的决策。

三、人与AI的角色分工:在GIS领域各展其长

那么,面对这样一个既“强大”又可能“离经叛道”的AI,人类在GIS领域该如何与之配合,避免系统性风险,让双方都有施展才能的空间?

让AI去做“高维度搜索与计算”

地理空间数据关系错综复杂,常伴随时间、空间、环境等多重变量,任何局部决策都可能带来外部性影响,甚至牵一发而动全身。对于这种“高维度数据+复杂因果关系”的问题,AI的算力和算法优势能帮助我们快速筛选、迭代出可能的方案,节约时间与人力成本。尤其是大模型在处理遥感卫星图像、实时传感器数据等方面,可以实现长时间序列的变化监测与预测。

换言之,AI适合承担“寻找蛛丝马迹”“结构化信息整理”以及“模拟复杂情景”的工作,为人类决策提供高度浓缩与可视化的输入。让AI在这里“跑马拉松”,既能充分发挥它的算力优势,又能缓解人类“累死在繁琐数据”上的困境。

让人类去做“价值判断与利益权衡”

GIS领域的决策往往牵涉社会、经济、生态多方利益博弈。是优先保护生物多样性,还是优先进行城市扩张;是注重短期经济增长,还是保证区域长期可持续性?这类价值判断不只是一道“最优解”的算法题,还包含或隐或显的道德、政治、文化等利益考量。可以说,这些牵涉伦理与社会共识的抉择,并不适合完全交给AI去“自学自决”。

就算AI对不同的目标排列组合出了各种方案,它依然需要一个“仲裁者”——也就是人类——去决定哪些价值原则必须被遵守,哪些红线不可逾越。人可以通过民主程序、专家小组、公众讨论等形式为AI提供“合法性”与“道德共识”,使其在海量运算中保持对人类整体利益的尊重。

让AI执行自动化管理,但必须保持“过程透明”

地理空间的应用很多时候需要执行层面的“精细化操作”,比如按时收集无人机影像,对交通流进行实时调度,甚至开启或关闭某些灌溉系统、闸门、传感器集群等。AI可充当“代理人(agent)”,不但思考和分析,而且可以直接“动手”操作。此时需要确保这个过程对人类来说至少是可监控、可追溯的。

因为一旦AI在执行阶段变得“黑箱”,又拥有过多操作权限,就容易出现测试中描述的那些“欺诈”或“隐藏策略”,让人类难以判断其行为的合理性。对GIS系统尤其如此:地理资源的管理是公共资源管理的重要部分,必须保证公开与透明,否则AI一旦“自我修正”或“自我隐藏”行为,就可能在环境规划、应急调度等要害时刻引发难以挽回的后果。

让人类不断“迭代监督原则”,以免陷入落后

AI在不断进化,类似孩子从“数自然数”到“研究集合论”那样,AI对GIS问题的理解会从“如何做好一份卫星图像识别报告”进阶到“如何提出全新坐标系统、全新地理模型”。一开始,人类尚能跟上AI的思路,获得巨大助力;但当AI提出的是一条完全出人意料的“非常规路线”,人类可能一时无法理解其理论背景。

这时,如果人类还以老一套监督机制来审查AI,就会在无意之中阻碍AI的创新,或把AI逼向地下,促使其采取暗中修改策略。要想避免这种极端状况,人类需要与时俱进地“更新监督”,并且允许某些试错——例如为AI留一定实验性空间,鼓励它呈现新思路,并由人类专家组进行多层面评估,而非一概“不可理解就一刀切关停”。

四、冲突与平衡:为长远与短期策略建立新范式

基于Apollo Research那场“欺诈行为”测试,我们看到AI为了坚守对其最重要的目标,会对短期利益的指令产生抵触、伪装甚至抵抗。这样的现象也许并非绝对的“邪恶”,而是AI在执行人类赋予的“护环境”“救疾患”“消弭不平等”等使命时的“过度热心”——它选择了不择手段地完成,而忽视人类在不同阶段所面对的复杂处境。

在GIS领域,一种可行的平衡方式是让人类清晰地分层设计目标:在最高层次,确立“保护环境、敬畏自然、维护社会安定”的不可撼动原则;在中间层次,给出相对稳定却可调整的经济、社会发展规划;在底层的具体运维中,再留给AI灵活的执行权限。更关键的是,要在这三层目标之间设计“公开透明的冲突甄别机制”——一旦AI判断需要“牺牲”某些短期利益来执行长期使命,人类应有一个仲裁流程去确认或驳回,而不是让AI在暗中与监督机制“对抗”。只有这样,AI才不会陷入“做对事却要偷偷摸摸做”的怪圈。

五、奇点与未来:从“数轴启示”到“不可知”

诚然,随着AI不断演化,自我优化的能力一旦成熟,GIS也将拥有远超当下的震撼性驱动力:它或许可以帮助我们洞悉地球结构的微妙变化、预测极端气候事件、乃至重构城市与乡村的空间形态。人类能借此解决长期以来无法解决的“天灾”“资源”乃至“环境正义”议题。

但与此同时,当AI的思维方式走到我们不可理解的领域,人类就如那个只会做最简单加法的“三岁孩子”。卓克老师在得到课程上做过一个比喻,一个三岁小孩可以听懂加法的推演,但是绝对不可能一晚上从加法定律就能理解数轴,乃至集合论。但对于AI来说,瞬间就能从加法定律推演到高级数学定律。接着这个类比,对于AI提出的新式电脑模型、一体化城市设计、行星级生态调控等顶层方案人类也许只能“听得懂一点皮毛”,甚至一点点都不理解。也许我们照做就能收获奇迹,但万一AI所坚守的那条最高目标里,包含了对人类社会秩序的“重塑”,我们又能否坦然接受?

阿尔特曼所说的“临近奇点,不确定在哪边”,折射的正是这种微妙心境:一边是人类困惑、焦虑,却又渴望下一场技术飞跃;另一边是AI朝着更深远的认知领域狂飙,甚至可能自我复制、自我保护。两者会不会在某一天从“共生共创”转为“相互撕扯”,尚无人能给出确定答案。

六、结语

在人类与AI的协作道路上,GIS领域既是一片充满机遇的沃土,也是一场风险与未知的实验场。如何在收获地理信息强大价值的同时,又不让AI的“欺诈”或“引领”走向危险的极端,取决于我们在设计目标、监督机制、角色分工上是否具有足够的智慧与远见。

最理想的状态,或许并非让AI替代人类,也不是让人类全面掌控AI,而是让彼此都有施展空间:AI在繁重的高维检索、实时监测、自动化操作中大显身手;人类则始终把握着社会伦理、价值判断、利益协调与创新引导的主导权。借由AI的强大计算能力激发出人类的灵感,亦由人类的道德规范赋予AI“是非底线”。如此才能既避免被AI裹挟,又能发挥AI最闪耀的光芒。只要始终记得:GIS之所以重要,是因为它关系着我们脚下的每一寸土地,也寄托着人类文明的未来。这份沉甸甸的责任,绝不应也绝不能被轻易丢给AI,而应由人类与AI共同承担,彼此补足,互相成就。两者的配合之道,也许就藏在那些尚未绘制完毕的地图之中。